¿Sueñan los LLMs con Ovejas Eléctricas?

Desde Blade Runner hasta los Transformers de 2017: un viaje por la evolución del lenguaje natural y la gran pregunta de 2026 — ¿pueden las máquinas entender de verdad?

En 1982, Blade Runner nos planteó un dilema que hoy, en 2026, ya no parece ciencia ficción: ¿Pueden las máquinas tener sentimientos?

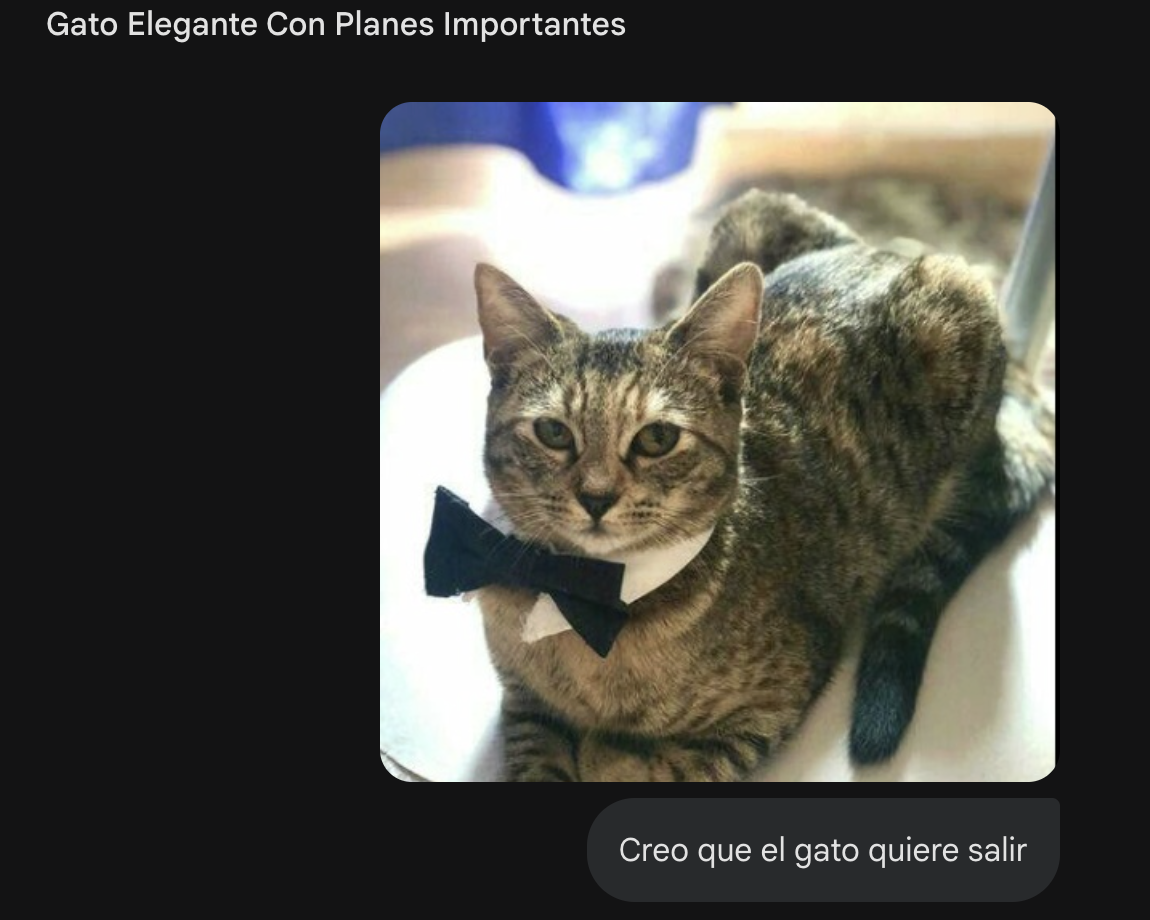

Este camarada quiere los reportes de ventas del último trimestre (eran para ayer)

Tyrell Corporation quería humanos "más humanos que los humanos". Nosotros, simplemente, queremos que la IA entienda un chiste.

El viaje: Las máquinas son aburridas

Si nos regresamos un poco, el procesamiento de lenguaje natural (PLN) ha sido una evolución de nuestra propia frustración.

- 👉 La era de las reglas (1950-1970): Intentamos programar el lenguaje a mano. Un error fatal. El lenguaje humano es demasiado ambiguo para ser enjaulado en diccionarios rígidos. Programar el sarcasmo a mano es como intentar vaciar el mar con una cuchara.

- 👉 La Revolución Estadística (2001): Empezamos a tratar las palabras como un "canal ruidoso". Si la señal llega distorsionada, la estadística nos ayuda a decodificar el mensaje.

- 👉 Deep Learning y Vectores (2008-2017): Aquí las máquinas dejaron de contar palabras y empezaron a "sentir" su cercanía. Los word embeddings convirtieron los significados en vectores. Palabras similares terminan cerca en un espacio multidimensional.

- 👉 Transformers (2017 - Presente): El salto definitivo. Ya no leemos palabra por palabra de izquierda a derecha. Gracias al mecanismo de atención, la IA analiza todas las palabras de una frase simultáneamente, obteniendo un contexto profundo.

La Actualidad: El Gato Elegante

Aquí es donde la tecnología choca con la psicología. Ya resolvimos cómo traducir y cómo generar texto. ¿Qué nos falta?

La discusión actual no es sobre gramática, es sobre la Teoría de la Mente (ToM). Es la capacidad humana de atribuir estados mentales, creencias y deseos a otros.

Para que un LLM pase un test como el benchmark BigToM, debe inferir qué cree una persona basándose en lo que vio, incluso si esa creencia es falsa. Entender el humor requiere razonar sobre mundos físicos, sociales y culturales.

¿Nos entienden de verdad? Cuando evaluamos si una red neuronal sabe que el gato se puso elegante porque "quiere salir de fiesta", estamos buscando ese destello de humanidad que Tyrell Corporation buscaba en sus androides.

Conclusiones

Estamos en un punto donde la IA ya no solo procesa datos; interpreta intenciones. Quizás no sueñen con ovejas eléctricas, pero están empezando a entender por qué nos reímos de un gato con moño.

Y eso, hace apenas diez años, era pura ciencia ficción.